Desde su lanzamiento para empresas de todos los tamaños, Copilot para Microsoft 365 se ha convertido en el cromo del álbum que todos los líderes de IT quieren tener. Sin embargo, hemos identificado que muchas empresas aún tienen dudas sobre el valor que aporta y sus limitaciones. En este artículo, compartimos los límites de la magia de Copilot.

Copilot para Microsoft 365 es un asistente que hace mucho más que redactar correos y crear presentaciones. Pero, aunque parezca magia, aún no lo es.

Muchas organizaciones nos suelen preguntar qué puede hacer y qué no puede hacer Copilot, y cuál es el verdadero valor que les aportaría a sus equipos de trabajo.

Para gestionar correctamente las expectativas y evitar frustraciones, aquí os compartimos los límites de la magia de Copilot:

1. Copilot no realiza acciones por sí mismo

Copilot para Microsoft 365 está diseñado para ayudar a las personas a realizar tareas específicas de manera más eficiente, pero no opera, analiza ni decide en lugar del usuario. Por ejemplo, puede entender lo que quieres hacer y ofrecer sugerencias, pero no ejecutará acciones por ti.

A pesar que técnicamente sí es factible que Copilot realice acciones por sí mismo, Microsoft evita que realice acciones directamente, siguiendo sus buenas prácticas para un uso responsable de la IA que establecen que el usuario siempre debe revisar sus respuestas antes de compartirlas con otra persona.

Por ejemplo, si estás redactando un correo electrónico importante y te quedas atascado en la estructura del mensaje, Copilot te dará sugerencias inteligentes en tiempo real para mejorar tu redacción y hacer que el mensaje sea más efectivo, pero no podrás pedirle que lo envíe por ti.

2. Copilot no lee la mente del usuario

Esto significa que Copilot no puede anticipar las necesidades o intenciones del usuario sin una comunicación clara y directa. Por ello, la formación en prompt engineering de los usuarios es tan importante para que sepan proporcionar instrucciones específicas y detalladas, con el fin de obtener los resultados deseados.

3. Copilot no aprende de conversaciones anteriores

Copilot para Microsoft 365 guarda todas las conversaciones que tiene con cada usuario. Es decir, si un día te quedas a medias pidiéndole que acabe de afinar un correo, al día siguiente puedes retomar desde donde lo dejaste.

Sin embargo, lo que no hace es aprender de las conversaciones ni mantener un contexto global: cada vez que interactúas con Copilot es como si fuera la primera vez.

Por ejemplo, si un día le pides ayuda para preparar una presentación y al día siguiente le pides que redacte un correo para enviar esa presentación, Copilot no recordará cuál es la presentación que te ha ayudado a preparar.

4. Copilot no toma decisiones

Debido a las limitaciones en el volumen de datos que puede procesar por cada consulta y el tipo de análisis que puede realizar, Copilot no puede realizar juicios objetivos ni tomar decisiones porque no puede establecer relaciones causales. Para análisis avanzados es preferible usar modelos analíticos especializados.

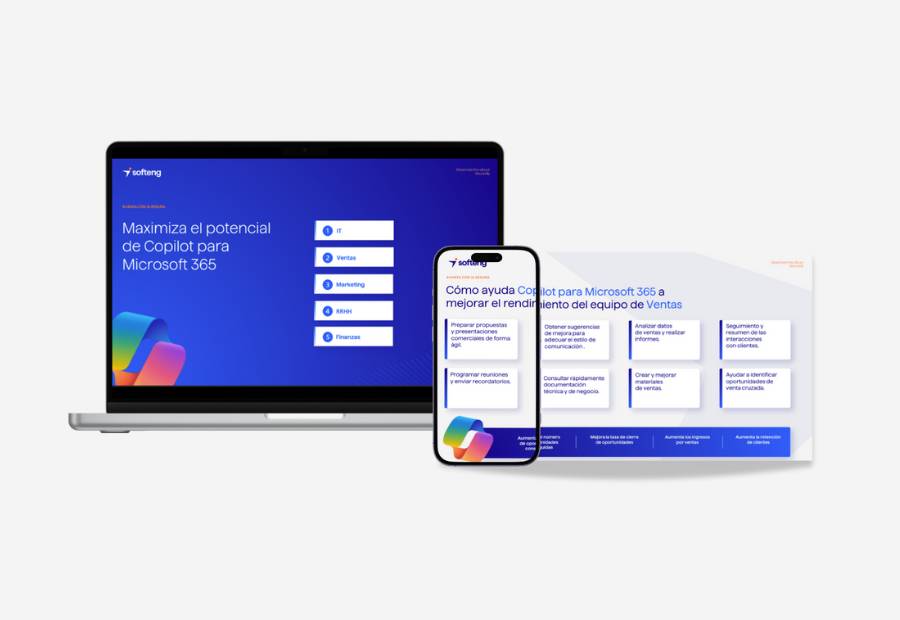

¿Quieres saber cómo sacarle el máximo partido a Copilot para Microsoft 365 sin frustrarte por el camino? Nuestros expertos en IA han identificado una serie de casos de uso de Copilot para Microsoft 365 en las distintas áreas de negocio.